LangChain — это платформа для создания больших языковых моделей с использованием искусственного интеллекта, позволяющая генерировать текст и взаимодействовать с людьми. Asyncio — это библиотека, которую можно использовать для многократного вызова такой модели, как LLM, с использованием одной и той же команды или запроса. Это также обеспечивает повышение скорости работы нашей модели LLM для эффективного создания текста.

В этой статье показано, как использовать библиотеку asyncio в LangChain.

Как использовать/выполнять библиотеку «asyncio» в LangChain?

Async API можно использовать в качестве поддержки LLM, поэтому для использования библиотеки asyncio в LangChain просто следуйте этому руководству:

Предварительные условия установки

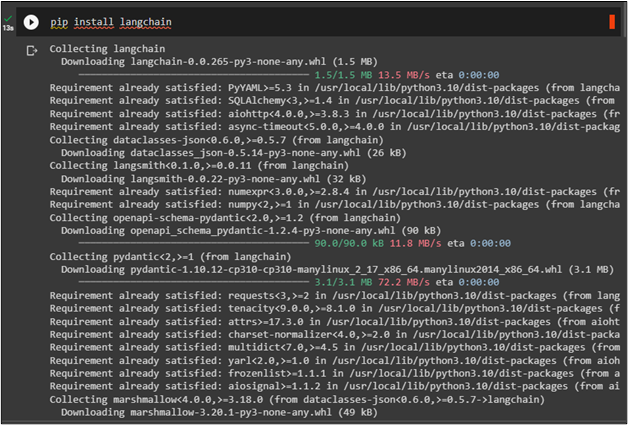

Установите модуль LangChain, чтобы начать использовать библиотеку asyncio в LangChain для одновременного вызова LLM:

пункт установить Лангчейн

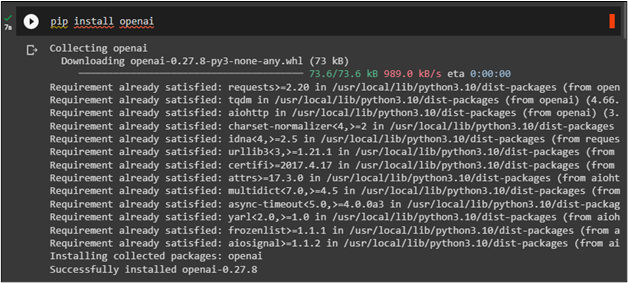

Модуль OpenAI также необходим для создания LLM с использованием OpenAIEmbeddings:

пункт установить опенай

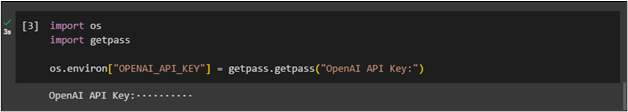

После установки просто настройте ключ API OpenAI, используя следующий код:

импортируйте насимпортировать getpass

os.environ [ 'ОПЕНАЙ_API_KEY' ] = getpass.getpass ( «Ключ API OpenAI:» )

Использование asyncio для создания LLM

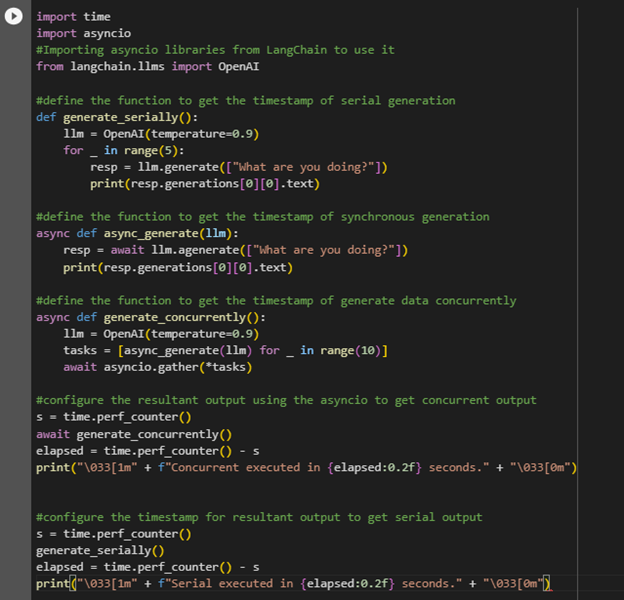

Библиотеку asyncio можно использовать для поддержки LLM, поскольку следующий код использует ее в LangChain:

Импортировать времяимпортировать асинхронный код

#Импорт асинхронных библиотек из LangChain для их использования

из langchain.llms импортировать OpenAI

#определите функцию для получения отметки времени генерации последовательного файла

защита генерировать_серийно ( ) :

llm = OpenAI ( температура '=' 0,9 )

для _ в диапазон ( 5 ) :

соотв = llm.generate ( [ 'Что ты делаешь?' ] )

Распечатать ( соответственно поколения [ 0 ] [ 0 ] .текст )

#определите функцию для получения отметки времени синхронной генерации

асинхронное определение async_generate ( лм ) :

resp = ожидание llm.agenerate ( [ 'Что ты делаешь?' ] )

Распечатать ( соответственно поколения [ 0 ] [ 0 ] .текст )

#определите функцию для получения отметки времени одновременной генерации данных

асинхронная защитаgenerate_concurrently ( ) :

llm = OpenAI ( температура '=' 0,9 )

задачи = [ async_generate ( лм ) для _ в диапазон ( 10 ) ]

ожидайте asyncio.gather ( * задания )

#настройте результирующий вывод, используя asyncio, для получения одновременного вывода

s = time.perf_counter ( )

ожидайте сгенерировать_параллельно ( )

прошедшее = time.perf_counter ( ) - с

Распечатать ( '\033[1м' + ж «Одновременное выполнение за {elapsed:0.2f} секунд». + '\033[0м' )

#настройте временную метку для результирующего вывода, чтобы получить последовательный вывод

s = time.perf_counter ( )

генерировать_серийно ( )

прошедшее = time.perf_counter ( ) - с

Распечатать ( '\033[1м' + ж «Последовательный выпуск выполнен за {elapsed:0.2f} секунд». + '\033[0м' )

Приведенный выше код использует библиотеку asyncio для измерения времени генерации текста с помощью двух разных функций, таких как генерировать_серийно() и генерировать_параллельно() :

Выход

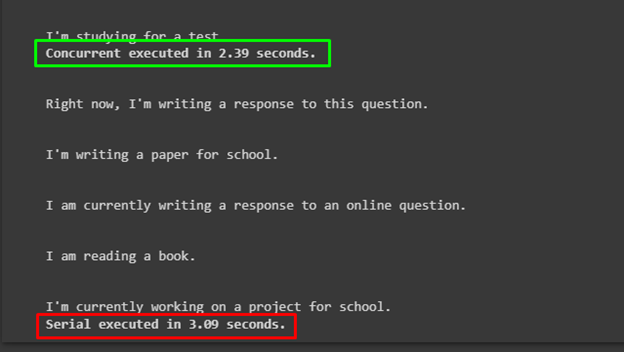

На следующем снимке экрана показано, что временная сложность как для функций, так и для одновременной генерации текста лучше, чем для последовательной генерации текста:

Вот и все, что касается использования библиотеки asyncio для создания LLM в LangChain.

Заключение

Чтобы использовать библиотеку asyncio в LangChain, просто установите модули LangChain и OpenAI, чтобы начать процесс. Async API может быть полезен при построении модели LLM для создания чат-ботов, позволяющих учиться на предыдущих обсуждениях. В этом руководстве объяснен процесс использования библиотеки asyncio для поддержки LLM с использованием платформы LangChain.