Библиотека «наборов данных» от Hugging Face предоставляет удобный способ работы с наборами данных и манипулирования ими для задач обработки естественного языка. Одной из полезных функций, предлагаемых библиотекой, является concatenate_datasets(), которая позволяет объединять несколько наборов данных в один набор данных. Ниже приводится краткий обзор функции concatenate_datasets() и способов ее использования.

concatenate_datasets()

Описание:

Библиотека наборов данных Hugging Face предоставляет функцию concatenate_datasets(). Он используется для объединения нескольких наборов данных, объединяя их в один набор данных вдоль указанной оси. Эта функция особенно полезна, когда у вас есть несколько наборов данных с одинаковой структурой, и вы хотите объединить их в единый набор данных для дальнейшей обработки и анализа.

Синтаксис:

от наборы данных Импортировать concatenate_datasets

объединенный_набор_данных '=' concatenate_datasets ( наборы данных , ось '=' 0 , Информация '=' Никто )

Параметры:

наборы данных (список наборов данных): список наборов данных, которые вы хотите объединить. Эти наборы данных должны иметь совместимые функции, что означает, что они имеют одинаковую схему, имена столбцов и типы данных.

ось (int, необязательно, по умолчанию=0): ось, по которой должно выполняться объединение. Для большинства наборов данных NLP используется значение по умолчанию 0, что означает, что наборы данных объединяются по вертикали. Если вы установите ось = 1, наборы данных объединяются по горизонтали, предполагая, что они содержат разные столбцы в качестве объектов.

Информация (datasets.DatasetInfo, необязательно): информация об объединенном наборе данных. Если не указано, информация выводится из первого набора данных в списке.

Возврат:

объединенный_набор_данных (Набор данных): результирующий набор данных после объединения всех входных наборов данных.

Пример:

# Шаг 1. Установите библиотеку наборов данных# Вы можете установить его с помощью pip:

# !pip установить наборы данных

# Шаг 2: Импортируйте необходимые библиотеки

от наборы данных Импортировать load_dataset , concatenate_datasets

# Шаг 3. Загрузите наборы данных обзоров фильмов IMDb.

# Мы будем использовать два набора данных IMDb, один для положительных отзывов.

#и еще один за отрицательные отзывы.

# Загрузить 2500 положительных отзывов

dataset_pos '=' load_dataset ( 'IMDB' , расколоть '=' 'поезд[:2500]' )

# Загрузить 2500 отрицательных отзывов

dataset_neg '=' load_dataset ( 'IMDB' , расколоть '=' 'поезд[-2500:]' )

# Шаг 4: Объедините наборы данных

# Мы объединяем оба набора данных по оси = 0, так как они

та же схема ( те же функции ) .

объединенный_набор_данных '=' concatenate_datasets ( [ dataset_pos , dataset_neg ] )

# Шаг 5: Анализ объединенного набора данных

# Для простоты посчитаем количество положительных и отрицательных

# отзывов в объединенном наборе данных.

num_positive_reviews '=' сумма ( 1 для этикетка в

объединенный_набор_данных [ 'этикетка' ] если этикетка == 1 )

num_negative_reviews '=' сумма ( 1 для этикетка в

объединенный_набор_данных [ 'этикетка' ] если этикетка == 0 )

# Шаг 6: Отобразите результаты

Распечатать ( 'Количество положительных отзывов:' , num_positive_reviews )

Распечатать ( 'Количество отрицательных отзывов:' , num_negative_reviews )

# Шаг 7. Распечатайте несколько примеров обзоров из объединенного набора данных.

Распечатать ( ' \п Несколько примеров отзывов:' )

для я в диапазон ( 5 ) :

Распечатать ( ж «Просмотр {i + 1}: {concatenated_dataset['text'][i]}» )

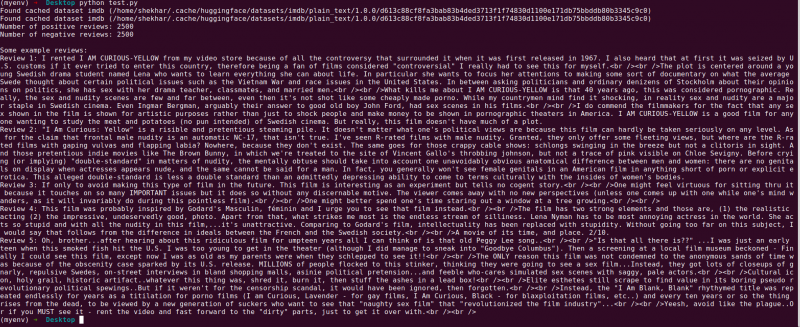

Выход:

Ниже приводится объяснение библиотечной программы «наборов данных» Hugging Face, которая объединяет два набора данных обзоров фильмов IMDb. Здесь объясняется назначение программы, ее использование и шаги, включенные в код.

Давайте предоставим более подробное объяснение каждого шага в коде:

# Шаг 1: Импортируйте необходимые библиотекиот наборы данных Импортировать load_dataset , concatenate_datasets

На этом этапе мы импортируем необходимые библиотеки для программы. Нам нужна функция «load_dataset» для загрузки наборов данных обзоров фильмов IMDb и функция «concatenate_datasets» для их последующего объединения.

# Шаг 2. Загрузите наборы данных обзора фильмов IMDb.# Загрузить 2500 положительных отзывов

dataset_pos '=' load_dataset ( 'IMDB' , расколоть '=' 'поезд[:2500]' )

# Загрузить 2500 отрицательных отзывов

dataset_neg '=' load_dataset ( 'IMDB' , расколоть '=' 'поезд[-2500:]' )

Здесь мы используем функцию «load_dataset» для получения двух подмножеств набора данных IMDb. Dataset_pos содержит 2500 положительных отзывов, а dataset_neg — 2500 отрицательных отзывов. Мы используем параметр разделения, чтобы указать диапазон загружаемых примеров, что позволяет нам выбрать подмножество всего набора данных.

# Шаг 3: Объедините наборы данныхобъединенный_набор_данных '=' concatenate_datasets ( [ dataset_pos , dataset_neg ] )

На этом этапе мы объединяем два подмножества набора данных IMDb в один набор данных под названием «concatenated_dataset». Мы используем функцию «concatenate_datasets» и передаем ее со списком, содержащим два набора данных для объединения. Поскольку оба набора данных имеют одинаковые функции, мы объединяем их по оси = 0, что означает, что строки накладываются друг на друга.

# Шаг 4. Анализ объединенного набора данныхnum_positive_reviews '=' сумма ( 1 для этикетка в

объединенный_набор_данных [ 'этикетка' ] если этикетка == 1 )

num_negative_reviews '=' сумма ( 1 для этикетка в

объединенный_набор_данных [ 'этикетка' ] если этикетка == 0 )

Здесь мы выполняем простой анализ объединенного набора данных. Мы используем списки вместе с функцией «сумма» для подсчета количества положительных и отрицательных отзывов. Мы перебираем « label» столбца «concatenated_dataset» и увеличивать счетчики всякий раз, когда мы сталкиваемся с положительной меткой (1) или отрицательной меткой (0).

# Шаг 5: Отобразите результатыРаспечатать ( 'Количество положительных отзывов:' , num_positive_reviews )

Распечатать ( 'Количество отрицательных отзывов:' , num_negative_reviews )

На этом этапе мы печатаем результаты нашего анализа — количество положительных и отрицательных отзывов в объединенном наборе данных.

# Шаг 6: Распечатайте несколько примеров отзывовРаспечатать ( ' \п Несколько примеров отзывов:' )

для я в диапазон ( 5 ) :

Распечатать ( ж «Просмотр {i + 1}: {concatenated_dataset['text'][i]}» )

Наконец, мы демонстрируем несколько примеров обзоров из объединенного набора данных. Мы просматриваем первые пять примеров в наборе данных и печатаем их текстовое содержимое, используя столбец «текст».

Этот код демонстрирует простой пример использования библиотеки «наборов данных» Hugging Face для загрузки, объединения и анализа наборов данных обзоров фильмов IMDb. Он подчеркивает способность библиотеки оптимизировать обработку наборов данных НЛП и демонстрирует ее потенциал для создания более сложных моделей и приложений обработки естественного языка.

Заключение

Программа Python, использующая библиотеку «наборов данных» Hugging Face, успешно демонстрирует объединение двух наборов данных обзоров фильмов IMDb. Загружая подмножества положительных и отрицательных отзывов, программа объединяет их в один набор данных с помощью функции concatenate_datasets(). Затем он проводит простой анализ, подсчитывая количество положительных и отрицательных отзывов в объединенном наборе данных.

Библиотека «наборов данных» упрощает процесс обработки и манипулирования наборами данных НЛП, что делает ее мощным инструментом для исследователей, разработчиков и практиков НЛП. Благодаря удобному интерфейсу и обширным функциональным возможностям библиотека позволяет легко выполнять предварительную обработку, исследование и преобразование данных. Программа, представленная в этой документации, служит практическим примером того, как можно использовать библиотеку для оптимизации задач объединения и анализа данных.

В реальных сценариях эта программа может служить основой для более сложных задач обработки естественного языка, таких как анализ настроений, классификация текста и моделирование языка. Используя библиотеку «наборов данных», исследователи и разработчики могут эффективно управлять крупномасштабными наборами данных, облегчать экспериментирование и ускорять разработку современных моделей НЛП. В целом, библиотека «наборов данных» Hugging Face является важным активом в стремлении к прогрессу в обработке и понимании естественного языка.